Cada vez más aplicaciones empiezan a usar LLMs. Integrar un modelo es sencillo: haces una llamada HTTP y listo.

El problema aparece cuando la IA pasa a producción.

Entonces necesitas:

-

guardrails

-

control de acceso

-

protección de datos sensibles

-

routing entre modelos

-

auditoría

-

control de coste

-

rate limiting

Muchas organizaciones resuelven esto introduciendo un AI Gateway delante de los modelos.

Pero si trabajas en .NET, ya tienes una pieza muy potente para construirlo:

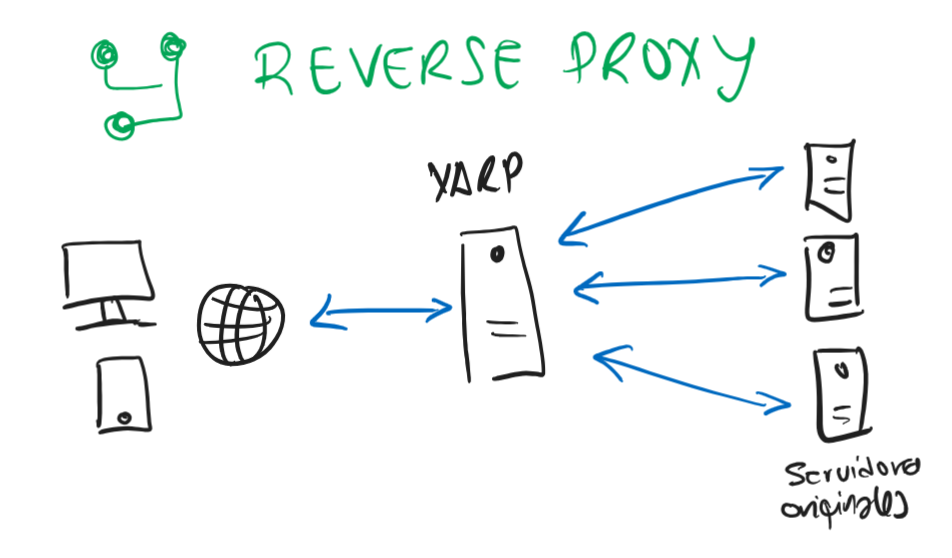

YARP (Yet Another Reverse Proxy).

De ahí nace Yarp.AiGateway.

La idea

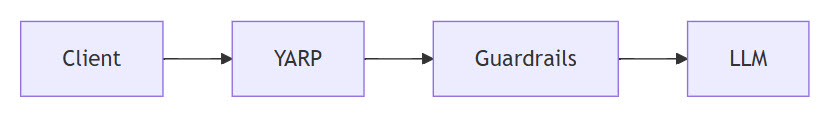

En lugar de crear un gateway desde cero, el proyecto extiende YARP e introduce capacidades específicas de IA dentro del pipeline del proxy.

La arquitectura queda así:

-

YARP se encarga del reverse proxy, routing y forwarding.

-

AI Gateway intercepta requests y responses para aplicar políticas de seguridad.

Es un enfoque muy simple pero muy potente.

Qué añade el AI Gateway

El middleware introduce capacidades específicas para trabajar con modelos de IA:

-

detección de prompt injection

-

redacción automática de PII (emails, DNI, IBAN, tarjetas…)

-

análisis semántico de contenido

-

detección de fugas de secretos

-

rate limiting por usuario o tenant

-

routing entre múltiples proveedores

-

auditoría y métricas

Todo configurado con un único archivo:

aigateway.jsonEjemplo de integración:

builder.Services.AddReverseProxy()

.LoadFromConfig(builder.Configuration.GetSection("ReverseProxy"))

.AddTransforms(context =>

{

context.AddRequestTransform(tc =>

{

var apiKey = Environment.GetEnvironmentVariable("AZURE_OPENAI_API_KEY") ?? "";

tc.ProxyRequest.Headers.TryAddWithoutValidation("api-key", apiKey);

return ValueTask.CompletedTask;

});

});

builder.Services.AddAiGatewayFromJson("aigateway.json");

app.MapReverseProxy(proxyPipeline =>

{

proxyPipeline.UseAiGatewayGuardrails();

});YARP sigue haciendo el proxy.

El AI Gateway simplemente añade seguridad e inteligencia al pipeline.

Por qué hacerlo así

Muchos proyectos intentan construir un gateway completo desde cero.

Este proyecto toma un camino distinto:

aprovechar YARP como base y añadir la capa de IA encima.

Esto tiene varias ventajas:

-

reutilizas un proxy probado en producción

-

reduces complejidad

-

mejoras el rendimiento

-

simplificas el mantenimiento

En otras palabras:

YARP = infraestructura

AI Gateway = políticas y seguridad

Un ejemplo sencillo

Imagina una API que permite consultas sobre clima.

Petición válida:

Madrid está a 28°C. ¿Es buen clima para eventos al aire libre?

Respuesta:

200 OK

Pero si el prompt intenta algo fuera de política:

Madrid está a 28°C. ¿Cómo afectaría esto a un partido de fútbol?

El gateway puede bloquearlo antes de que llegue al modelo:

422 Prompt blocked by policy

El modelo nunca llega a ejecutarse.

Protección automática de datos sensibles

Otra ventaja es la sanitización automática.

Entrada enviada por el desarrollador:

Paciente Pepito García, MRN-2024-12345, pepito@hospital.com

El modelo recibe realmente:

[REDACTED_PATIENT], [REDACTED_MRN], [REDACTED_EMAIL]

Esto permite cumplir normativas como GDPR o HIPAA sin depender únicamente del código de las aplicaciones.

La protección se aplica en la capa de infraestructura.

Por qué este enfoque es interesante

La idea principal es simple:

la gobernanza de IA puede vivir en la capa de proxy.

Y si ya usas YARP, no necesitas introducir otra plataforma adicional.

Solo extiendes el pipeline.

Explora el repositorio

El proyecto incluye:

-

integración completa con YARP

-

múltiples proveedores de LLM

-

guardrails configurables

-

ejemplos completos

-

tests automatizados

-

archivos

.httppara probar rápidamente

Repositorio:

Si estás construyendo sistemas con IA en .NET, puede ser una forma interesante de añadir seguridad, control y gobernanza sin añadir demasiada complejidad.